华为版ChatGPT将于7月7日发布

6月4日消息,据钛媒体,华为公司将发布一款直接对标ChatGPT的多模态千亿级大模型产品,名为“盘古Chat”。

据介绍,盘古大模型于2020年11月在华为云内部立项成功。这款“盘古Chat”预计将于今年7月7日举行的华为云开发者大会(HDC.Cloud 2023)上对外发布以及内测,产品主要面向To B/G政企端客户。

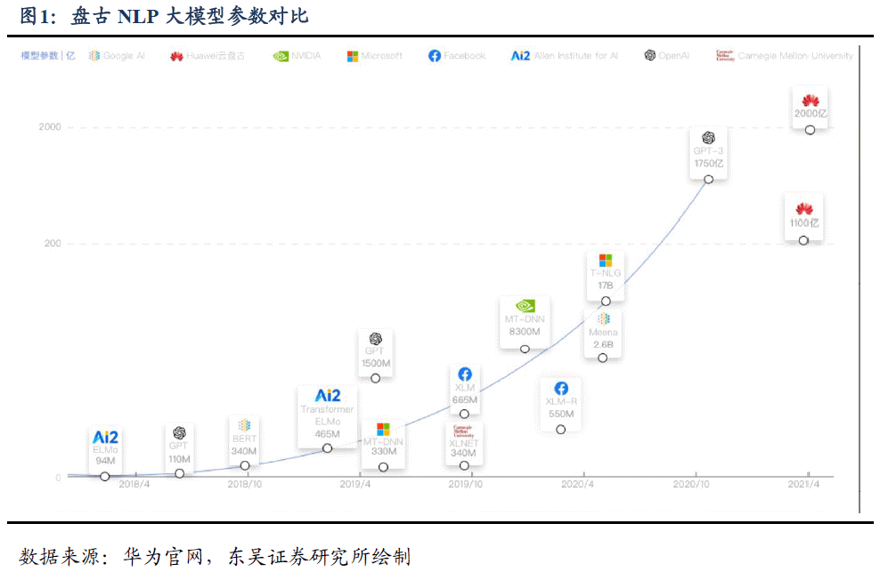

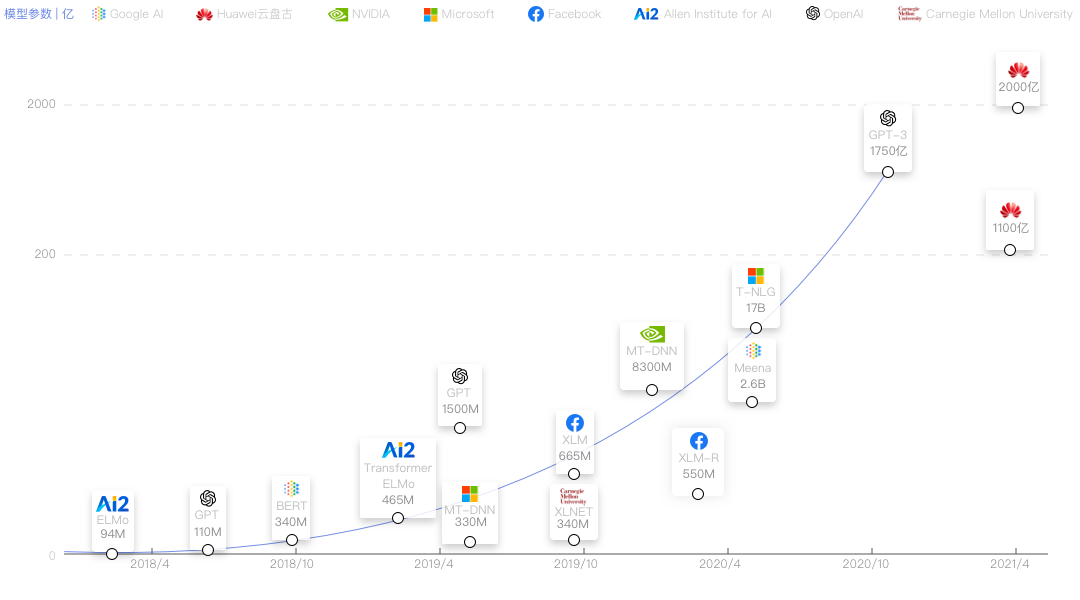

根据华为公布的一份论文数据显示,华为盘古PanGu-Σ大模型参数最多为1.085万亿,基于华为自研的MindSpore框架开发。整体来看,PanGu-Σ大模型在对话方面可能已接近GPT-3.5的水平。

公开资料显示,华为盘古大模型于2021年4月正式对外发布,后来又在2022年4月升级到2.0版本。目前,AI大模型中的NLP大模型、CV大模型以及科学计算大模型(气象大模型)均已被标记为即将上线状态。

据介绍,这是首个千亿参数中文预训练大模型,CV大模型则首次达到30亿参数。盘古CV大模型业界最大CV大模型、首次实现兼顾判别与生成能力、在ImageNet上小样本学习能力上的业界第一;盘古气象大模型提供秒级天气预报;紫东.太初是全球首个图、文、音三模态大模型。

对于盘古大模型定位,华为内部团队确立了三项最关键的核心设计原则:一是模型要大,可以吸收海量数据;二是网络结构要强,能够真正发挥出模型的性能;三是要具有优秀的泛化能力,可以真正落地到各行各业的工作场景。

根据华为云高管的演讲PPT信息,目前华为“盘古系列AI大模型”基础层主要包括NLP大模型、CV大模型、以及科学计算大模型等,上层则是与合作伙伴开发的华为行业大模型。

华为云官网显示,盘古大模型由NLP大模型、CV大模型、多模态大模型、科学计算大模型等多个大模型构成,通过模型泛化,解决传统AI作坊式开发模式下不能解决的AI规模化、产业化难题,可以支持多种自然语言处理任务,包括文本生成、文本分类、问答系统等等。

具体来看,盘古NLP大模型首次使用Encoder-Decoder架构,兼顾NLP大模型的理解能力和生成能力,保证了模型在不同系统中的嵌入灵活性。下游应用中,仅需少量样本和可学习参数即可完成千亿规模大模型的快速微调和下游适配,这一模型在智能舆论以及智能营销方面都有不错的表现。

盘古NLP大模型

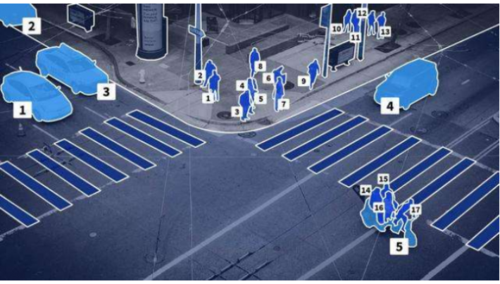

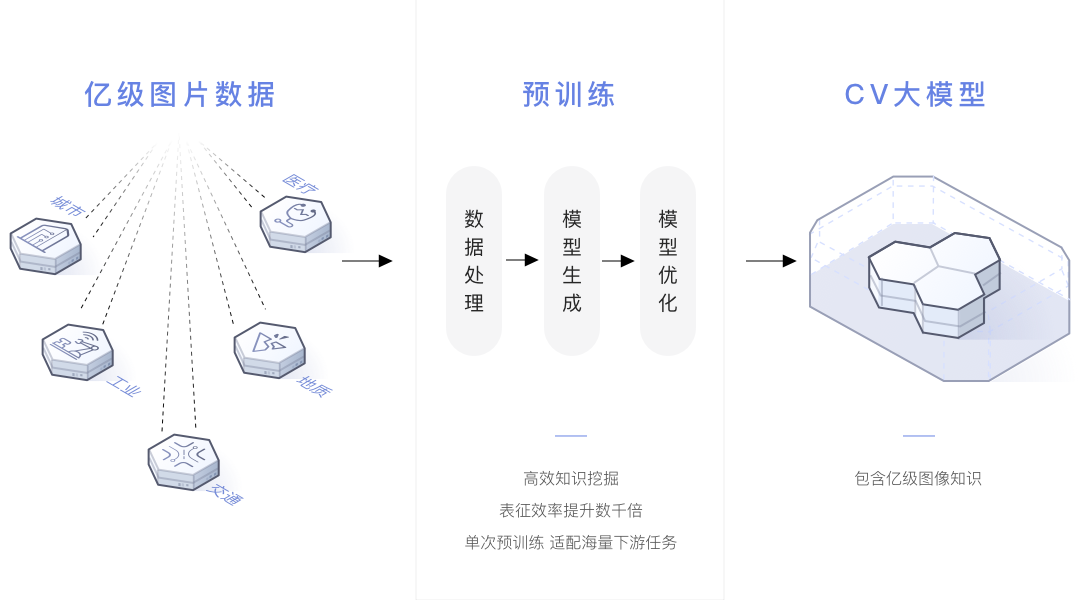

盘古CV大模型是首次实现模型按需抽取的业界最大CV大模型,首次实现兼顾判别与生成能力,基于模型大小和运行速度需求,自适应抽取不同规模模型,AI应用开发快速落地。使用层次化语义对齐和语义调整算法,在浅层特征上获得了更好的可分离性,使小样本学习的能力获得了显著提升,达到业界第一,这一模型在智能巡检以及智慧物流方面有不错的表现。

盘古CV大模型

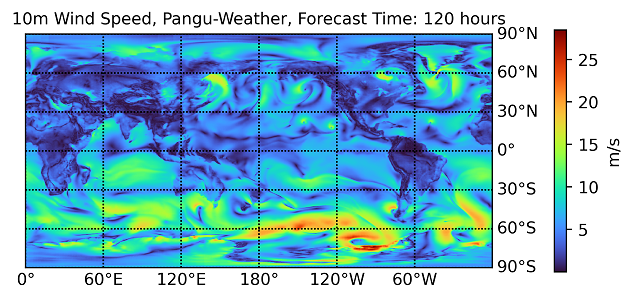

盘古气象大模型提供秒级天气预报,借助创新的3DEST网络结构以及分层时间聚合算法,在气象预报的关键要素和常用时间范围上精度均超过当前最先进的预报方法,速度相比传统方法提升1000倍以上。同时,盘古气象大模型支持广泛的下游预报方案,如在台风路径预测任务上,相比传统数值气象预报方法,盘古气象大模型可以降低20%以上的位置误差。

盘古气象大模型

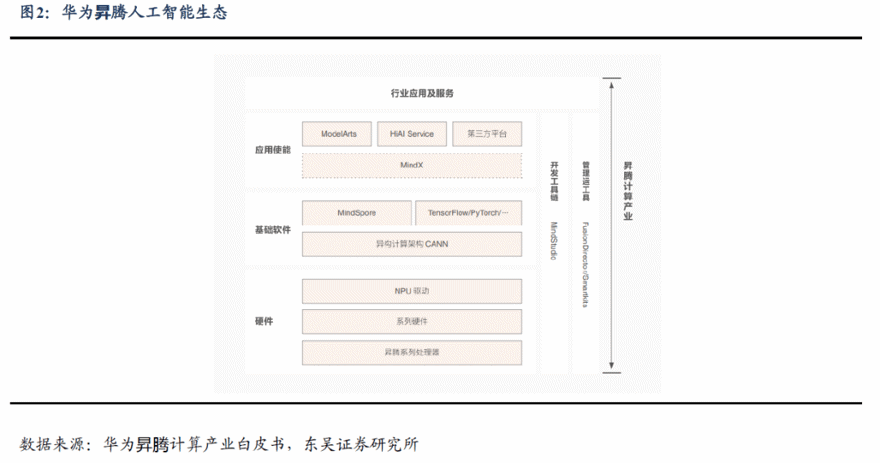

浙商证券此前披露的信息显示,华为在训练千亿参数的盘古大模型时调用了超过2000块的昇腾910芯片,进行了超2个月的数据训练能力。华为内部称,每年大模型训练调用GPU/TPU卡超过4000片,3年的大模型算力成本高达9.6亿元人民币。

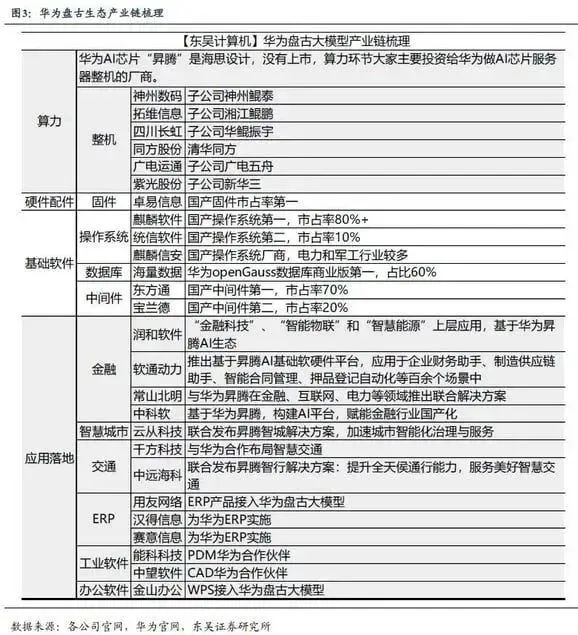

东吴证券梳理的华为盘古大模型产业链研报中指出,华为盘古大模型的优势在于人才储备和算力自主可控,有望成为国内领先的大模型,其生态产业链标的有望迎来加速发展,包括拓维信息、四川长虹、麒麟软件(中国软件)、统信软件(诚迈科技)、麒麟信安等华为生态公司。国盛证券则认为,华为盘古为首个多模态千亿级大模型,有望赋能百业。

▲图源:东吴证券